精选顶级区块链游戏娱乐平台,支持USDT、比特币等数字资产支付。畅玩去中心化游戏平台,体验公平透明的区块链游戏应用。立即加入,探索丰富的USDT支付游戏平台,享受安全便捷的加密货币娱乐!年初,宇树突然放大招,发布了5900美元的R1人形机器人。要知道,就在一年前,业内普遍认为人形机器人的成本底线万美元,宇树这一招,相当于把整个行业的价格预期直接打碎。

紧接着,Figure AI的估值从2024年的26亿美元一路狂飙到390亿美元,达到了15倍的增长。投资方名单读起来像科技圈的奥斯卡颁奖典礼:微软、OpenAI、英伟达、贝佐斯、英特尔、三星。

但与此同时,特斯拉喊出要生产5000台Optimus的豪言壮语,实际只组装了大约1000台就按下暂停键,面临重新设计。马斯克那句“特斯拉八成的价值将来自于Optimus”的豪言,在现实面前显得有些尴尬。

这一冷一热,实在是有点让人困惑。具身智能到底发展到哪一步了?本篇文章就将从算法、硬件、数据、资本以及主要大玩家路线等等这几个方向一一给大家展开解读。

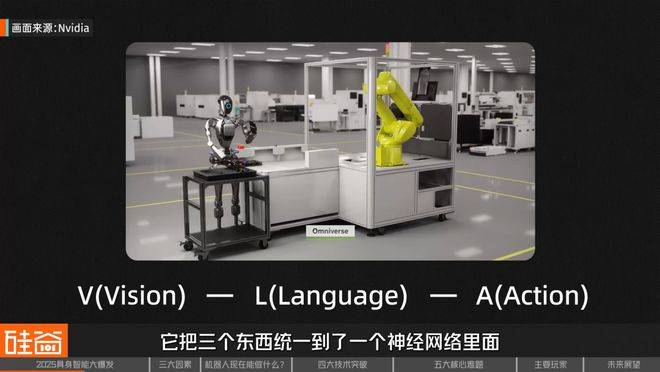

如果说ChatGPT是“会说话”的AI,那具身智能就是“会动手”的AI。它的核心是VLA,Vision-Language-Action,视觉-语言-动作模型。它把三个东西统一到一个神经网络里:Vision(视觉):看到当前的场景;Language(语言):理解任务目标和常识;Action(动作):输出具体的控制指令。

打个比方,传统工业机器人就像只会背固定台词的演员,你给它编好程序,它就按部就班执行;但具身智能机器人更像会即兴表演的演员,它能理解环境变化,自主做决策。

比如你让它叠毛巾,传统机器人需要毛巾每次摆放位置完全一样。但具身智能机器人能识别:哦,这次毛巾皱了、偏了,那我调整一下动作轨迹,照样能叠好。

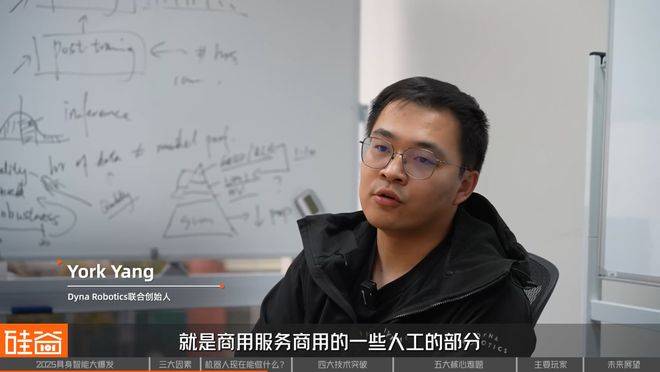

Dyna Robotics是硅谷炙手可热的具身智能公司,一年前刚成立,如今A轮融资达到1.2亿美元,估值6亿美元,投资人包括英伟达。而“叠毛巾”这个任务正是让Dyna最先火出圈的demo。

这就是质的飞跃:机器人不再是执行固定程序的机械臂,而是通过视觉-语言-动作的集合,能理解、能规划、能适应的智能体。

无论是OpenAI还是其他公司近期发布的大模型,能力提升已更多体现为增量式演进,而非早期从GPT-3.5到GPT-4那样的跨越式跃迁。在这一背景下,大模型的整体能力正在趋于稳定,且已经足以作为具身智能系统的可靠基础能力层。

ChatGPT证明了,大语言模型能理解复杂指令、做推理规划。这套能力可以迁移到机器人上:你说“帮我做早餐”,它能规划出“先拿鸡蛋、再打蛋、然后开火煎”这样的多步骤序列。

第二,算力价格腰斩再腰斩。随着芯片厂商不断推出性能更强的新一代芯片,等效算力的单位成本呈现长期下降趋势,往往每隔几年,获得同等算力所需的成本就会降至此前的一半。

2023年,租一张NVIDIA H100 GPU还是天价。现在,云服务的算力价格战愈演愈烈,训练大模型的成本大幅降低。以前只有头部公司玩得起的游戏,现在创业公司也能上桌。

机器人硬件整体的零部件成熟度已经相对较高。尤其是在过去一年人形机器人热潮的推动下,大量资本和工程资源被投入到核心基础部件的研发中,包括电机、减速器等关键组件,使得相关技术持续成熟的同时,成本也在不断下降。

宇树直接把价格打到5900美元,此前,行业普遍认为2-3万美元的区间已经能实现规模化生产。成本曲线的陡降,让商业化不再是天方夜谭。

这三股力量叠加,把具身智能从实验室推向了商业化的前夜。但这不是盲目的乐观,而是基于技术成熟度的理性判断。所以,目前具身智能的能力边界在哪里,它能做什么?

叠毛巾、叠衣服,听起来简单,但Dyna的机器人能做到24小时叠700条毛巾,成功率99.4%。这在酒店、洗衣房已经是实打实的生产力。而且他们的基础模型里面包含了各种各样的场景数据,像切菜、切水果,准备食物,早餐清扫和物流分拣。

宝马集团BMW的工厂里,Figure的机器人在做简单装配和物料搬运。Agility Robotics的Digit在仓储物流场景搬箱子。1X也将向瑞典巨头EQT交付最多1万台1X Neo人形机器人,主要应用于制造、仓储、物流等工业场景。更别提亚马逊已经部署了100万台专用机器人,几乎要超过其156万人类员工的数量。

这些都不是Demo,是真实在跑的商业项目。这就是“理性前行”——不求全能,但求实用。

目前有什么还做不到,头部公司正在攻克的任务呢?比如说:中等难度的任务,像做早餐。

这是个“长线任务”,需要规划多个步骤:拿食材、切菜、摆盘、开火、翻炒。每一步都要精准执行,还得控制力度,不能把鸡蛋捏碎,也不能切菜切到手。Dyna最新的demo显示已经攻克了做早餐这个长线任务。

而Figure也展示过两台机器人协同工作的Demo,一台递工具,一台操作。这在家用场景很有用,但稳定性还在打磨。

而最难的是家务。因为每个家庭环境都不一样。光照变化、物品摆放、家庭成员走动,这些都是“非结构化环境”的挑战。

相对来说,工厂是“结构化环境”,光线固定、物品位置固定、流程标准化。但家里完全是另一回事。而且家务还有个致命要求:零容错。机器人在工厂打碎个零件,损失可控。在家里打碎碗、伤到人,那就是事故。

这就是“理性前进”——不是等到机器人变成科幻电影里的全能管家再推向市场,而是从一个明确的、用户真正需要的功能切入,逐步迭代。

虽然挑战重重,但2025年确实有几个值得关注的技术突破。业内人士很坦诚地告诉我们,每一个突破都不是革命性的,但都是实实在在的进步。

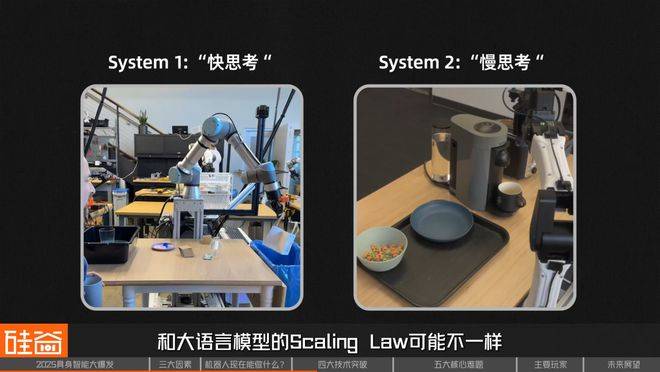

System 1是“快思考”,负责反射性动作,比如抓取、移动,参数量小,响应快,可能只有8000万参数。

System 2是“慢思考”,负责复杂规划,比如“做早餐”这种多步骤任务,参数量大,可能有70亿参数。

Figure AI的Helix模型就是这个架构的代表作。它们在和OpenAI“分手”后,两周内迅速推出这个自研模型,创新性地用单一神经网络控制整个上半身的35个自由度,还能同时控制两台机器人协作。

这种架构的成功,证明了机器人基础模型和大语言模型的Scaling Law可能不一样——不是越大越好,而是要找到合适的参数分配策略。

机器人数据为什么这么贵?原因也很简单:因为人类一天只有24小时,收集真实操作数据太慢太贵。

NVIDIA的解决方案是:用模拟器生成合成数据。他们展示过,11小时内生成78万条操作轨迹。相当于6500小时或连续九个月的人类演示数据。虽然合成数据和真实数据有差距,但至少解决了“数据荒”的燃眉之急。

Physical Intelligence的π0模型、开源的OpenVLA模型都能控制多种不同的机器人。同一套模型或策略,不需要为每一种机器人重新训练,就能够在不同形态、不同硬件配置的机器人上有效工作,这就叫跨机器人泛化能力。

这很重要。以前每种机器人都要单独训练模型,成本高昂。现在一个模型适配多种机器人,数据可以共享,成本大幅降低。

但技术难点也很明显:不同机器人的动作空间差异巨大,手臂长短不一、关节数量不同,怎么让一个模型都能控制好?

这种在完全陌生环境也能工作的能力,不是100%完美,但已经是实质性的进步。

Figure展示过用单一神经网络协调两台机器人协作。创新性地用单一神经网络,控制整个上半身的35个自由度,同时还能控制两台机器人协作。

听起来简单,实际上难度很高。两台机器人要互相配合,时序、力度、位置都要精准同步。这在未来工厂场景会很有用,但现在还处于早期验证阶段。

这些技术突破,没有一个是颠覆性的,但每一个都在扎实推进。这正是2025年的特点:不再追求炫酷的Demo,而是在可验证、可量化、可复现的方向上稳步前进。

技术突破是一方面,但行业里还有几座大山没翻过去。清楚认识这些难题,恰恰是“理性前进”的前提,也让现在的具身智能来到了大爆发的前夜。

首先,是数据困境。ChatGPT训练用了万亿级token,相当于把整个互联网的文字都喂给它了。

但机器人操作数据极度稀缺。Google训练RT-2模型,花了17个月在线万条数据,场景泛化能力依然有限。

为什么机器人数据这么难收集?因为需要真实机器人在真实环境操作,每一条数据都要花钱花时间,出错还可能损坏设备。这不像文本数据,爬虫跑一跑就有了。所以大多数机器人基础模型仍依赖于少量真实数据加大量模拟合成数据加强化学习/自监督方法。

在虚拟世界训练机器人很便宜,可以同时跑几万个模拟器。但虚拟世界永远不等于真实世界。就像你玩赛车游戏很厉害,不代表线。

真实世界的摩擦力、柔软度、光线变化太复杂,仿真只能还原部分真实物理特性。剩下的就是机器人从模拟器到真实世界“水土不服”的根源。

NVIDIA的Genesis和Isaac模拟器在努力缩小这个gap(差距),但完全消除还需要时间。

人手有27个关节,能感知压力、温度、质地。机器人的灵巧手通常只有15-22个关节,传感器也没那么精细。即使完美模仿人类的动作轨迹,效果也不同。人类能轻柔地拿起鸡蛋,机器人可能一用力就捏碎。

这就意味着,特斯拉想用YouTube上海量人类视频训练Optimus的策略,面临巨大的技术挑战。这也是为什么特斯拉在生产了1000台后暂停重新设计。理想很美好,现实很骨感。

ChatGPT回答错了,用户笑笑就过去了。机器人动作错了,可能砸坏东西、伤到人。这是质的区别。

具身智能必须达到极高的可靠性,才能真正走进工厂、走进家庭。这个标准比大语言模型严苛得多。

目前人形机器人价格需要降到2万美元左右,才能在物流等场景形成足够吸引力。

但价格下降需要规模化生产。规模化生产需要大量订单。大量订单需要价格足够低。

这是个循环困境,需要有人先打破僵局。宇树的5900美元定价就是在尝试打破这个僵局,但能否引发价格战,带动整个行业降本,还需要观察。

认清这些难题,不是悲观,而是理性。正是因为目前初创公司们都很实在地承认这些瓶颈存在,具身智能才来到了爆发的前夜。

这一派公司包括了特斯拉和Figure,他们的策略是软硬件一体化,打造数据闭环。

Tesla利用FSD自动驾驶技术的积累,把视觉感知、路径规划的能力迁移到Optimus上,还能用工厂的生产线积累数据。前工程主管Milan Kovac说得很直白:“我们只是从轮子上的机器人变成长着腿的机器人。”

但现实比预期复杂。5000台的目标只完成了五分之一,就不得不暂停重新设计。这说明即使是特斯拉这样的巨头,在embodiment gap面前也要低头。

Figure则在和OpenAI“分手”后,独立开发了Helix模型,自己掌控技术路线。两周内推出的Helix模型,展示了他们确实有技术实力。15倍的估值涨幅,也证明资本市场对这条路线的认可。

但他们真正商业化部署的也就几十台。Demo很精彩,规模化还在路上。第二派就是我们刚才提到的Physical Intelligence和Skuid AI。

与多家同时押注硬件的机器人初创公司不同,这些公司的策略是模型先行,跨平台适配。

Physical Intelligence的π0模型不绑定特定硬件,能适配多种机器人。他们的逻辑是:先把模型能力做强,硬件可以后续选择最优方案。

而另外一家则是Skild AI,一家专注于构建机器人基础模型的软件公司。Skild AI核心方向同样是打造一种与具体机器人形态无关的通用基础模型,可根据不同机器人平台和应用场景进行适配与定制。

今年7月,Skild AI发布了其通用机器人系统Skild Brain,并公开演示视频,展示机器人完成拿取餐具、上下楼梯等操作能力。近期软银与英伟达正计划对它投资10亿美元,把它的估值提升到140亿美元。

NVIDIA提供模拟器和算力基础设施,推出GR00T N1并开源,但你要用就得用全套NVIDIA生态。Google则在学术研究上持续投入,RT系列模型影响了整个学术界。

他们为整个行业提供“水电煤”。谁能制定行业标准,谁就掌握了生态控制力。

这三种路线,都在前进。没有哪一派已经占据绝对优势,大家都在试错、迭代、调整。

技术上,大模型+机器人的结合已经跑通,但远未成熟。数据、泛化、可靠性这些核心难题还没解决。

如果用“GPT时刻”来类比,自变量机器人CTO王浩认为,我们现在是GPT-2的水平。

注意,是GPT-3,不是GPT-4。这就是毫不花哨的判断。由于研究员们看到了这种规模化带来的提升,所以路径和目标更加明确,也更加唯一。

而在商业上,工业场景开始试点,仓储、制造、服务业都有落地案例。但大规模商用可能还需要2-3年时间。

投资上,可以说泡沫和机会并存。有公司估值飙升,也有公司暂停生产,也有公司钱烧光了而破产。

开源机器人公司K-Scale Labs融资失败倒闭,Figure AI拿钱拿到手软,这两个极端同时存在,说明市场正在分化,虽然具身智能的长期趋势确定,但短期波动剧烈。

有可能是家务任务,也可能是仓储物流,或者是餐饮清洁服务。而无论是哪个场景,都已经有重量级玩家在布局。具身智能不是“会不会发生”的问题,而是“什么时候发生”。

2025年,我们正站在这场革命的起点。行业不再只展示炫酷的Demo,而是开始脚踏实地验证技术、打磨产品、寻找场景。

Figure AI估值飙升,不只是资本炒作,而是他们交出了Helix这样的实质成果。

Dyna从叠毛巾切入,不是格局小,而是在积累数据飞轮,培养模型的学习能力。

Physical Intelligence部分开源π0,不是不够开放,而是在商业利益和技术分享之间找平衡。

这种在现有基础上稳步提升,恰恰是行业走向成熟的标志。2025年,具身智能行业已经从“画大饼”,进化到卷起袖子和面团。这个饼,正在一点一点,有分寸地,变成现实。